목록분류 전체보기 (216)

Practice makes perfect

[MachineLearning] tensorflow 이용 - Softmax 함수

[MachineLearning] tensorflow 이용 - Softmax 함수

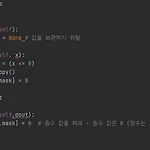

Softmax 함수 : 최종출력의 결과를 확률적인 의미로, 최종 출력의 합이 1이 되도록 변환해주는 함수입니다. - 학습시 최종출력단에 softmax함수를 연결시켜주는 것이 일반적입니다. 0) 데이터 정리 1) 가설함수 정의 - softmax 함수 2) 손실함수 정의 3) 경사하강법 적용( Gradient Descent Algorithm ) 4) tensorflow 흐름

[MachineLearning] tensorflow 이용 - 로지스틱 분류분석

[MachineLearning] tensorflow 이용 - 로지스틱 분류분석

로지스틱 분류분석(Logistic Regression) - 2가지 분류군으로 사용(0 / 1 encoding) 예제1) 공부시간과 합격과의 관계 0) 데이터 정리 1) 가설함수 정의 : logistic regression 적용 시그모이드 함수(회쉬분석 식) 2) 손실함수(CEE) - ylog(H(x)) - (1-y)log(1-H(x)) 3) 경사하강법 알고리즘 4) tensorflow 실행 예제2) 당뇨병 환자 데이터 셋(759명의 데이터 셋) - 70~80% 학습, 20~30% 확인 0) 데이터 정리 1) 가설함수 정의 2) 손실함수 정의 (CEE) 3) 경사하각법 적용 4) tensorflow의 흐름 console) 1개 빼고는 정답과 동일한 결과를 출력합니다.

[MachineLearning] 머신러닝 개요

[MachineLearning] 머신러닝 개요

머신러닝(MachineLearning) : 어플리케이션을 수정하지 않고도 데이터를 기반으로 패턴을 학습하고 결과를 예측하는 알고리즘 기법을 통칭 합니다. ● 추가 설명 - 데이터를 기반으로 통계적인 신뢰도를 강화하고 예측 오류를 최소화하기 위한 다양한 수학적 기법을 적용해 데이터 내의 패턴을 스스로 인지하고 신뢰도 있는 예측 결과를 도출합니다. - 데이터 분석 영역은 재빠르게 머신러닝 기반의 예측분석 (Predictive Analysis)으로 재편되고 있습니다. - 많은 데이터 분석가와 데이터 과학자가 머신러닝 알고리즘 기반의 새로운 예측모델을 이용해 더욱 정확한 예측 및 의사 결정을 도출하고 있으며 , 데이터에 감춰진 새로운 의미와 통찰력 ( 를 발굴해 놀랄 만한 이익으로 연결시키고 있습니다. - 귀납..

[MachineLearning] tensorflow 이용 - 선형회귀

[MachineLearning] tensorflow 이용 - 선형회귀

선형회귀(Linear Regression Analysis) : 독립변인이 종속변인에 영향을 미치는지 알아보고자 할 때 실시하는 분석 방법입니다. 선형성이라는 기본 가정이 충족된 상태에서 독립변수와 종속변수의 관계를 설명하거나 예측하는 통계방법으로 회귀분석에서 독립변수에 따라 종속변수의 값이 일정한 패턴으로 변해 가는데 , 이러한 변수간의 관계를 나타내는 회귀선이 직선에 가깝게 나타나는 경우를 의미합니다. - 선형이기 때문에 어떤 X 값이라도 W와 b만 정의되면 알 수 있습니다. 종 류 - 단순회귀분석 : 독립변수가 하나인 경우 - 다중회귀분석 : 독립변수가 여러 개인 경우 단순 선형 회귀 분석 H(x) = Wx + b x : 독립변수 y : 종속 변수 W : 직선의 기울기 (가중치 : weight) b ..

[MachineLearning] tensorflow1 사용을 위한 환경 설정

[MachineLearning] tensorflow1 사용을 위한 환경 설정

anaconda prompt를 관리자 권한으로 실행합니다. 파이썬 버전 확인 - python --version 3.7 버전은 tensorflow 2버전과 호환성을 가지고 있고, 3.6 버전은 tensorflow 1버전과 호환성을 가지고 있기 때문에 버전이 상당히 중요합니다. 버전이 맞지 않아서 환경이 틀어져 버리면 돌이킬 수 없는 상황이 올 수 있습니다. 그런 상황을 대비해서 가상환경을 통해서 사용해보도록 하겠습니다. - 가상환경 구축하기 conda create -n 이름, 파이썬 버전 입력 - 3.6 버전은 tensorflow 1버전과 호환성을 가지고 있기 때문에 3.6 버전으로 가상환경을 구축합니다. - 가상환경 확인 conda env list - 가상환경으로 들어가기 conda activate 환경..

[DeepLearning] 오차역전파법 (backpropagation)

[DeepLearning] 오차역전파법 (backpropagation)

오차역전파법 (backpropagation) : 가중치 매개변수의 기울기를 효율적으로 계산하는 방법 결과값을 손실함수로 변환한다 손실함수의 기울기를 수치 미분 기울기가 0이 되는 지점까지 weight를 변화 - 수치 미분을 통하여 기울기를 구하는데, 이는 단순하고 구현하기는 쉽지만 계산 시간이 오래 걸린다는 단점이 있습니다. 따라서, 가중치 매개변수의 기울기를 가장 효율적으로 계산할 수 있는 오차역전파법(backpropagation)을 사용합니다. 순전파 : 왼쪽 -> 오른쪽 역전파 : 오른쪽 > 왼쪽 계산 그래프 : 계산 그래프는 계산 과정을 그래프로 나타낸 자료구조로, 복수의 노드와 에지로 표현합니다. 예제1) 현빈 군은 슈퍼에서 1개에 100원인 사과를 2개 샀습니다. 이때 지불금액을 구하시오, 단..

[DeepLearning] 확률적 경사 하강법(SGD), 학습 알고리즘 구현

[DeepLearning] 확률적 경사 하강법(SGD), 학습 알고리즘 구현

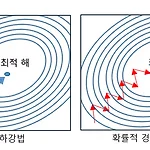

확률적 경사 하강법 (Stochastic Gradient Descent, SGD) : 데이터를 미니배치로 무작위로 선정하여 경사 하강법으로 매개변수를 갱신하는 방법으러 추출된 데이터 한개에 대해서 그래디언트를 계산하고, 경사 하강 알고리즘을 적용합니다. +) 추출된 데이터 한 개에 대해서 error gradient 를 계산하고, Gradient descent 알고리즘을 적용하는 방법 모델의 레이어 층은 하나의 행렬곱으로 생각할 수 있고, 여러개의 묶음 데이터는 행렬이라고 생각 할 수 있습니다. 즉, 여러개의 묶음 데이터를 특정 레이어 층에 입력하는 것은 행렬 x 행렬로 이해할 수 있는데, SGD는 입력 데이터 한 개만을 사용하기 때문에 한 개의 데이터를 '벡터' 로 표현하여 특정 레이어 층에 입력하는 것..

[DeepLearning] 신경망 학습

[DeepLearning] 신경망 학습

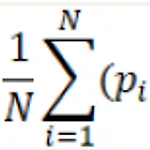

신경망 : 퍼셉트론에서 출발하여 여러 입력신호를 입력받아서 출력을 내보내주는 표현이 퍼셉트론이었는데, 퍼셉트론과의 차이는 활성화 함수를 어떤 것을 사용하느냐에 차이를 가집니다. 퍼셉트론은 스텝 함수를 사용하고, 신경망은 시그모이드 함수를 사용합니다. 스텝 함수는 선형성이고, 시그모이드 비선형입니다. 게이트를 통해서 결과를 확인할 때, XOR는 비선형의 형태를 통해서 코드상으로 구현할 수 있습니다. 코드의 형태를 봤을 때, 입력과 출력의 형태로만 되어있던 것을 은닉층을 통해 다층의 구조를 가져갈 때, 활성화 함수를 시그모이드 함수로 활용하여 선형적으로 절대 분류 할 수 없었던 특징을 비선형으로 구현할 수 있게 되었습니다. 신경망 학습 : 데이터로부터 매개변수의 값을 정하는 방법 - ex) y = ax + ..